licenta2noua2

Click here to load reader

-

Upload

daralautata4764 -

Category

Documents

-

view

207 -

download

4

Transcript of licenta2noua2

UNIVERSITATEA TEHNICA DIN CLUJ-NAPOCAFACULTATEA DE ELECTRONICA, TELECOMUNICATII SI

TEHNOLOGIA INFORMATIEISpecializarea Tehnologii şi sisteme de Telecomunicaţii

Contribuţii la analiza şi implementarea unor metode de extragere a caracteristicilor din imagini în vederea clasificării lor

Lucrare de licenţă

PRESEDINTE COMISIE, DECAN,Prof. dr. ing Gavril Toderean Prof.dr.ing. Marina ŢOPA

CONDUCATOR, ABSOLVENT,Asist. ing. Anca Apătean Alexandru Mihu

2010

UNIVERSITATEA TEHNICA DIN CLUJ-NAPOCAFACULTATEA DE ELECTRONICA, TELECOMUNICATII SI

TEHNOLOGIA INFORMATIEICATEDRA DE COMUNICAŢII

Titlul temei: Contribuţii la analiza şi implementarea unor metode de extragere a caracteristicilor din imagini în vederea clasificării lor

Enunţul lucrarii de licenţă:

Proiectul trebuie să conţină metodologia de alegere a caracteristicilor extrase din imagini, implementarea unei aplicaţii Matlab de extragere a trăsăturilor din imaginile bazei de date pentru clasificarea acestora. Obiectivele sunt documentarea metodelor de extragere a trăsăturilor deja existente, clasificarea imaginilor pe baza trăsăturilor extrase şi realizarea din punct de vedere aplicativ a unei interfeţe grafice de extragere a trăsăturilor şi clasificare a imaginilor.

Locul de executie: Laborator 211

Data emiterii temei: 20 februarie 2009

Termen de predare: 24 iunie 2010

ŞEF CATEDRĂ, ABSOLVENT,Prof.dr.ing. Virgil DOBROTA Alexandru Mihu

CONDUCATOR,Asist.ing. Anca Apătean

FACULTATEA DE ELECTRONICĂ, TELECOMUNICAŢII ŞI TEHNOLOGIA INFORMAŢIEI

Declaraţia autorului

Subsemnatul declar prin prezenta că ideile, partea de implementare şi experimentală, rezultatele, analizele şi concluziile cuprinse în această lucrare constituie efortul meu propriu, mai puţin acele elemente ce nu-mi aparţin, pe care le indic şi le recunosc ca atare.

Declar de asemenea, că după ştiinţa mea, lucrarea în această formă este originală şi nu a mai fost niciodată prezentată sau depusă în alte locuri sau altor instituţii decât cele indicate în mod expres de mine.

În calitate de autor, cedez toate drepturile de utilizare şi modificare a lucrării de licenţă către Universitatea Tehnică din Cluj-Napoca.

Cluj-Napoca, 24 iunie 2010

ABSOLVENT,

Alexandru Mihu

1. absolvent Alexandru Mihu

2. asist. ing. Anca Apătean

SINTEZA LUCRARII DE LICENŢĂ

Contribuţii la analiza şi implementarea unor metode de extragere a caracteristicilor (trăsăturilor) din imagini în vederea clasificării lor

Imaginile digitale, costul redus de realizare şi stocare al acestora, precum şi utilizarea lor în tot mai multe domenii ale ştiinţei şi ingineriei, au introdus o creştere a cererii de aplicaţii de analiză şi clasificare a imaginilor cu o precizie cât mai mare şi într-un timp cât se poate de scurt.

Lucrarea urmăreşte extragerea trăsăturilor din imaginile unor obstacole ce se pot găsi în scenele rutiere pentru a obţine o acurateţe a clasificării cât mai mare. Imaginile sunt grupate în patru categorii: maşini, pietoni, animale şi garbage, fiind în număr de 200 pentru fiecare clasă. Aceste obiective au fost realizate prin studierea mai multor referinţe bibliografice. Soluţia adoptată este reprezentată de utilizarea unor metode de extragere a trăsăturilor ce fac parte din metodologia de formare a vectorului de caracteristici al clasificatorului WND-CHARM [9].

Numărul de trăsături extrase a fost redus, prin renunţarea la metodele ineficiente de extragere în ceea ce priveşte performanţele de clasificare, la 318 atribute pe imagine comparativ cu 1024 atribute pe imagine folosite pentru formarea vectorului de trăsături din cadrul clasificatorului WND-CHARM. Astfel, timpul de extragere al trăsăturilor tuturor imaginilor din baza de date, precum şi timpul de clasificare au fost micşorate semnificativ (de aproximativ 11 ori pentru timpul de extragere al trăsăturilor tuturor imaginilor din baza de date şi de aproximativ 3 ori pentru timpul de clasificare al celor 20% din imaginile ficărei clase destinate testării).

Prin modificarea bazei de imagini aplicaţia realizată poate fi utilizată în probleme de detecţie sau recunoaştere din diverse domenii.

ABSTRACT

Digital images, cheap costs of acquisition and storage, as well as increasing use in many fields of science and engineering, introduces a demand of image analysis and classification with high accuracy and lower classification time.

This thesis follows feature extraction from obstacle images that can be found in traffic scenes with high classification accuracy. The images are grouped in four main groups, each with with 200 images ilustrating cars, pedestrians, animals and backgrounds. This objectives were achieved by studying several bibliographic references. The adopted solution is reprezented by use of feature extraction methods that are part of feature vector forming described in WND-CHARM classifier [9]. Number of features per image have been reduced from 1024 attributes per image used in WND-CHARM feature vector to 318 attributes per image, by removing the inefficient extraction methods in terms of clasification performance. Thus, the time needed for feature extraction for all database images and classification time was reduced significantly (approximately 11 times for feature extraction time, respectively 3 times for test images classification time).

By changing the image database the application can be used in detection and recognition problems in many field of science and engineering.

CURRICULUM VITAE

Name and surname: Alexandru MihuDate of birth: 16th of November 1986

Studies: High School: Colegiul Naţional „Lucian Blaga”, Sebeş Tehnical University of Cluj Napoca

Professional activity: Internship at RDS & RCS S.A., technical advisor

Technical Knowledge: Advanced PC operating and programming skills:

Microsoft Windows and Office suite; Pascal , FoxPro, C , C++ , C# , embedded C, Java.

Electronical and mechanical CAD skills: OrCAD suite , AutoCAD

Known languages: English: Writing, Reading, Speaking: Very Good German: Writing: Acceptable, Reading: Acceptable, Speaking: Acceptable

Contact address: Address: Str.Valea Frumoasei 5C/8, Sebeş, Alba Telephone: 0746 041 672 E-mail address: [email protected]

I the undersigned, Alexandru Ioan Mihu, declare that all the data in this Curriculum Vitae can be used by The Faculty of Electronics, Telecommunications and Information Technology of the Technical University of Cluj- Napoca, for promotional pourposes and professional orientation, in the following conditions:

Without prior consult After prior consult I do not agree

Cuprins

1. Stadiul actual...............................................................................................................................1

2. Fundamentare teoretică...............................................................................................................2

2.1. Introducere.........................................................................................................................2

2.2 Transformata Wavelet continuă şi discretă........................................................................3

2.2.1 Transformata Wavelet continuă.................................................................................3

2.2.2 Transformata Wavelet discretă...................................................................................4

2.2.3 Familii de wavelet-uri:...............................................................................................5

2.2.4 Aplicaţii ale wavelet-urilor.........................................................................................5

2.3 Transformata FFT...............................................................................................................6

2.3.1 Definirea transformatei FFT......................................................................................6

2.3.2 Aplicaţii ale transformatei FFT..................................................................................7

2.4 Transformata Radon............................................................................................................7

2.4.1 Definirea transformatei Radon...................................................................................7

2.4.2 Aplicaţii ale transformatei Radon..............................................................................8

2.5 Caracteristicile Tamura.......................................................................................................8

2.5.1 Granularitatea............................................................................................................8

2.5.2 Contrastul...................................................................................................................9

2.5.3 Direcţionalitatea.........................................................................................................9

2.6 Polinoamele Zernike..........................................................................................................10

2.6.1 Definirea polinoamelor Zernike...............................................................................10

2.6.2 Aplicaţii ale polinoamelor Zernike...........................................................................11

2.7 Histograme multi-scală.....................................................................................................11

2.8 Filtre orientate în patru direcţii pentru obţinerea "primelor 4 momente"........................11

2.9 Algoritmul KNN................................................................................................................12

2.9.1 Avantajele algoritmului KNN...................................................................................13

2.9.2 Dezavantajele algoritmului KNN.............................................................................13

2.10 Fişiere MEX (MEX-files).................................................................................................14

3. Implementarea soluţiei adoptate...............................................................................................14

3.1 Baza de imagini.................................................................................................................15

3.2 Metoda de extragere a caracteristicilor............................................................................17

3.2.1 Metoda de extragere a caracteristicilor din WND-CHARM....................................19

3.2.2 Metoda de extragere a caracteristicilor adoptată....................................................20

3.2.3 Evaluarea trăsăturilor în Weka...............................................................................23

3.2.4 Evaluarea trăsăturilor în Matlab.............................................................................25

3.3 Determinarea parametriilor transformatei Wavelet..........................................................25

3.4 Modul de împărţire a datelor pentru învăţare şi testare...................................................27

3.5 Îmbunătăţirea performanţelor...........................................................................................28

3.5.1 Reducerea numărului de trăsături extrase din fiecare imagine……………………...35

3.5.2 Transformarea aplicaţiei într-un executabil.............................................................29

3.6 Interfaţa grafică a aplicaţiei..............................................................................................30

3.6.1 Extragerea trăsăturilor.............................................................................................31

3.6.2 Clasificarea imaginilor.............................................................................................31

3.6.3 Testarea clasificatorului KNN şi cu alte imagini decât cele din baza de date.........31

4. Rezultate experimentale.............................................................................................................31

4.1 Rezultate experimentale Weka...........................................................................................32

4.2 Rezultate experimentale din Matlab şi din aplicaţia executabilă......................................30

5. Concluzii....................................................................................................................................35

6. Bibliografie................................................................................................................................37

7. Anexe..........................................................................................................................................39

7.1 Anexa 1..............................................................................................................................39

Codul Matlab al funcţiei de realizare a transformatei Wavelet..................................................39

7.2 Anexa 2..............................................................................................................................39

Codul Matlab pentru obţinerea fişierului ce conţine trăsăturile imaginilor din baza de date.....39 7.3 Anexa 3..............................................................................................................................39

Codul Matlab al funcţiei de extragere trăsături............................................................................39

7.4 Anexa 4..............................................................................................................................41

Codul Matlab pentru obţinerea fişierului cu liniile vectorului de caracteristici permutate.........41

Codul Matlab pentru funcţia prelucrarefisierIN...........................................................................41

Codul Matlab pentru functia preiaDatelePtPrel...........................................................................42

7.5 Anexa 5..............................................................................................................................43

Codul Matlab pentru clasificarea KNN.........................................................................................43

7.6 Anexa 6..............................................................................................................................44

Codul Matlab al aplicaţiei GUI.....................................................................................................44

Codul Matlab pentru metodele de extragere folosite în aplicaţia GUI.........................................63

Codul Matlab pentru extracţia trăsăturilor din fiecare imagine în funcţie de metodele alese în aplicaţia GUI.................................................................................................................................64

Lista de figuri

Figura 1.1 Schema procesului de recunoaştere şi clasificare automată a imaginilor......................3Figura 2.1 Arborele cu primele trei nivele de descompunere DWT(arborele Mallat)....................4Figura 2.2 Arborele Mallat cu primele trei nivele de reconstrucţie ale semnalului original...........4Figura 2.3 Familii de wavelet (a) Haar (b) Daubechies4 (c) Coiflet1 (d) Symlet2 (e)Meyer(f) Morlet(g) Mexican hat.....................................................................................................................5Figura 2.4 Cele două forme ale transformatei Radon- ecuaţia (7) şi (9)........................................7Figura 2.5 Valorile Zernike în unitatea de disc.............................................................................10Figura 3.1 Imagini din baza de date...............................................................................................16Figura 3.2 Schema bloc a metodelor de extragere a trăsăturilor...................................................17Figura 3.3 Schema de formare a vectorului de trăsături din cadrul WND-CHARM....................19Figura 3.4 Grupele de caracteristici din WND-CHARM..............................................................22Figura 3.5 Schema de formare a vectorului de trăsături................................................................22Figura 3.6 Structura fişierului ARFF la modul general.................................................................23Figura 3.7 Structura fisierului ARFF utilizat în acestă lucrare......................................................23Figura 3.8 Matricele de confuzie pentru învăţare, respectiv testare..............................................24Figura 3.9 Transformata Wavelet a unei imagini..........................................................................27Figura 3.10 Schema bloc a clasificării KNN.................................................................................27Figura 3.11 Schema bloc de realizare a executabilului.................................................................29Figura 3.12 Interfaţa grafică a lucrării...........................................................................................30Figura 4.1 Matrice de confuzie Weka (numărul de vecini=1).......................................................32Figura 4.2 Matricele de confuzie pentru k=3 (a), respectiv k=5 (b) obţinute în Weka.................32Figura 4.3 Matricele de confuzie pentru setul de testare (k=1,3 şi 5) obţinute în Weka...............33Figura 4.4 Matricele de confuzie pentru setul de testare obţinute în Matlab.................................33Figura 4.5 Graficul timpilor de clasificare KNNR şi KNNC în funcţie de numărul de trăsături..........................................................................................................................................34Figura 4.6 Graficul timpului de clasificare în funcţie de numărul de trăsături..............................34Figura 4.7 Graficul timpului de extragere coeficienţi în funcţie de numărul de trăsături.............35Figura 4.8 Graficul acurateţii în funcţie de numărul de trăsături...................................................35

Lista de tablele

Tabel 3.1 Metode de extragere a trăsăturilor analizate..................................................................22Tabel 4.1 Rezultate obţinute în Matlab..........................................................................................33Tabel 4.2 Rezultate obţinute prin transformarea aplicaţiei într-un executabil..............................34

1. Stadiul actual

Stadiul actual în ceea ce priveşte recunoaşterea formelor şi clasificarea automată a imaginilor este unul avansat, reuşindu-se dezvoltarea unor aplicaţii care au o acurateţe a clasificării foarte ridicată şi un timp de clasificare sau de detecţie foarte bun (detecţie sau clasificare în timp real), şi care încet-încet promit a se apropia ca performanţă de modul natural cu care fiinţa umană tratează această problemă.

Imaginile digitale, stocarea ieftină şi utilizarea acestora în tot mai multe domenii ale ştiinţei şi ingineriei, au introdus o creştere a cererii de aplicaţii de analiză şi clasificare a imaginilor cu o precizie cât mai mare. Aceste aplicaţii includ teledetecţia, descrisă în [1], recunoaşterea facială, despre care se pot găsi informaţii în [2], [3] sau [4] şi clasificarea imaginilor medicale şi biologice [5], [6], [7] sau [8].

Sistemele de vedere artificială sunt proiectate după modelul sistemelor biologice, în special cel uman. În dezvoltarea unor astfel de sisteme ne lovim, de foarte multe probleme. Cea mai importantă dintre ele este imposibilitatea de a reproduce modul nostru de gândire în sistemele artificiale. Pentru noi oamenii, recunoaşterea unui obiect se face cu uşurinţă, chiar dacă acel obiect nu este văzut în întregime, dar în general nu putem explica ştiinţific cum am reuşit să realizăm recunoaşterea. Prin urmare, nu putem dezvolta un algoritm sau o tehnică de inteligenţă artificială care descrie iterativ şi exact acest proces.

Deşi în ultimii ani au atras o atenţie deosebită, analiza şi clasificarea imaginilor sunt deocamdată considerate probleme competitive în sistemele de prelucrare şi clasificare pe baza conţinutului imaginilor (CBIR - Content Based Image Retrieval), datorită complexităţii subiectului în ceea ce priveşte imaginile reale şi dificultatea de extragere cantitativă a trăsăturilor de similitudine sau diferenţiere dintre imagini. Aceste trăsături în general includ caracteristici de culoare, textură sau formă. Caracteristicile sunt obţinute global, prin extragerea informaţiilor pe baza mediei histogramelor de culoare (pentru caracteristicile de culoare), pe baza granularităţii, contrastului şi directivităţii imaginilor (pentru caracteristicile de textură) şi pe baza trăsăturilor de curbură, momente invariante, circularitatea şi excentricitatea imaginilor (pentru caracteristicile de formă). Cu toate acestea, extragerea trăsăturilor din imagini se face diferit în funcţie de detaliile particulare ale aplicaţiei şi performanţele dorite.

În lucrarea de faţă sunt propuse mai multe metode deja existente de extragere a caracteristicilor pentru formarea vectorului de trăsături şi clasificarea imaginilor pe baza vectorului obţinut.

Scopul principal al acestei lucrări este testarea mai multor metode de extragere a trăsăturilor. Pentru a vedea eficienţa metodelor de extragere a caracteristicilor s-a realizat clasificarea imaginilor pe baza vectorului de caracteristici prin intermediul clasificatorului IBk din Weka (echivalentul KNN- K Nearest Neighbor) şi KNN implementat în Matlab. Aceste obiective au fost realizate prin studierea mai multor referinţe bibliografice. Soluţia adoptată este reprezentată de utilizarea unor metode de extragere a trăsăturilor ce fac parte din metodologia de formare a vectorului de caracteristici al clasificatorului WND-CHARM (Weighted Neighbor Distances using a Compound Hierarchy of Algorithms Representing Morphology[9]) - distanţa ponderată dintre vecini utilizând o ierarhie compusă de algoritmi morfologici. Pentru mai multe detalii a se consulta [9].

Trăsăturile vectorului de caracteristici includ descompunerea polinomială (reprezentată de polinoamele Zernike), elementele de statistică a pixelilor (media, deviaţia standard, skewness- oblicitatea, kurtosis- planitatea, histogramele multi-scală) şi caracteristicile de textură (contrast, granularitate şi direcţionalitate). Aceste caracteristici au fost extrase din imaginile pe nivele de gri, precum şi din imaginile rezultate în urma transformatelor Wavelet (a imaginii pe nivele de gri şi a transformatei FFT- Fast Fourier Transform a imaginii pe nivele de gri). O altă transformată utilizată este transformata Radon a imaginii pe nivele de gri, care este folosită pentru extragerea informaţiei spaţiale.

1

Metodele aplicate asupra imaginilor pentru formarea vectorului de trăsături fac parte din metodologia descrisă în [9]. Contribuţia adusă la formarea vectorului de trăsături constă în selectarea din varietatea de metode de extragere doar a celor care oferă o performanţă de clasificare mai ridicată. Pentru o aplicare eficientă a transformatei Wavelet s-au stabilit valorile parametrilor: familia de wavelet şi nivelul de descompunere wavelet. Celelate metode utilizate, precum şi implementările lor în Matlab pot fi descărcate gratuit şi utilizate în scopuri ştiinţifice şi de cercetare de pe site-ul: http://www.openmicroscopy.org.

Vectorul de trăsături este utilizat apoi pentru clasificarea imaginilor de test într-un set de clase de imagini predefinit (clasa maşini, pietoni, animale şi garbage) cu ajutorul utilitarului Weka. Deoarece apelarea din Matlab a utilitarului Weka este foarte complicată şi datorită faptului că s-a dorit dezvoltarea unei aplicaţii de sine stătătoare în Matlab, s-a ales implementarea în Matlab a unui algoritm de clasificare. În luarea deciziei asupra clasei imaginii de test s-a folosit algoritmul KNN. Din punct de vedere al evaluatorului s-a ales folosirea KNN deoarece este un clasificator rapid, eficient şi uşor de implementat. Pentru a nu permite clasificatorului să înveţe inclusiv ordinea de preluare a imaginilor s-a realizat permutarea imaginilor din vectorul de caracteristici.

Din punct de vedere aplicativ, lucrarea conţine o interfaţă grafică dezvoltată cu ajutorul toolbox-ului GUIDE (Graphical User Interface Design Environment) din Matlab. Această aplicaţie permite utilizatorului să selecteze diferite variante de formare a vectorului de trăsături, precum şi posibilitatea testării clasificatorului KNN cu alte imagini decât cele din baza de date. Vectorul de trăsături poate avea, în funcţie de metodele selectate de utilizator, o dimensiune minimă de 72 caracteristici şi maximă de 318 caracteristici. Toate atributele sunt extrase pe baza imaginilor pe nivele de gri, astfel informaţiile de culoare nefiind utilizate.

2. Fundamentare teoretică

2.1. Introducere

În realizarea unei aplicaţii de recunoaştere a formelor şi clasificare automată a imaginilor, după cum se poate observa în figura 1.1, în general se parcurg următoarele etape:a) preprocesarea imaginii - etapă în care se realizează îmbunătăţirea calităţii imaginilor prin aplicarea unor algoritmi DIP (digital image processing).[10]

Deoarece imaginile din baza de date formată pentru acestă lucrare nu necesită alte îmbunatăţiri ale calităţii, în acestă etapă s-a realizat doar conversia imaginilor color în imagini pe nivele de gri. În multe situaţii, pentru clasificarea imaginilor sunt extrase pe lângă trăsăturile de textură şi de formă, şi cele de culoare. S-a renunţat la aceste caracteristici deoarece nu se poate realiza o diferenţiere a claselor pe baza culorii şi obiectele vizate de aplicaţia de faţă se găsesc într-un mediu exterior, unde informaţia de culoare este foarte bogată şi variată.b) extragerea caracteristicilor sau trăsăturilor din imagine - reprezintă etapa cea mai importantă deoarece influenţează în mod direct performanţele de clasificare.[10]

Tipul trăsăturilor folosite în clasificare şi descrise în această lucrare se împart în trei categorii: descompunere polinomială, statisticile pixelilor şi textură. În descompunerea polinomială este generat un polinom ce aproximează imaginea în funcţie de gradul de fidelitate, iar coeficienţii acestui polinom sunt utilizaţi ca trăsături ai conţinutului imaginii. Caracteristicile de textură se referă la variaţia în intensitate între pixelii imaginii pentru diferite direcţii şi rezoluţii. Statisticile pixelilor se bazează pe distribuţia pixelilor din imagine şi includ histograme şi momente.

În această etapă, pentru extragerea trăsăturilor, asupra imaginilor s-a aplicat transformata Wavelet (transformata Wavelet a imaginii pe nivele de gri şi transformata Wavelet a transformatei FFT a imaginii pe nivele de gri), iar din rezultatele obţinute au fost extrase

2

caracteristicile de statistică a pixelilor ("primele 4 momente", histogramele multi-scală) şi de textură (caracteristicile Tamura). Din imaginile originale (imaginile pe nivele de gri), fără a aplica asupra acestora nici o transformată, sunt extrase caracteristicile de statistică a pixelilor şi de textură menţionate mai sus, precum şi cele de descompunere polinomială (polinoamele Zernike). Din vectorul de trăsături mai fac parte şi caracteristicile obţinute în urma transformatei Radon a imaginii pe nivele de gri. c)evaluarea caracteristicilor sau trăsăturilor - este o etapă în care sunt evaluate datele din vectorul de caracteristici şi care are ca rezultat în mod obişnuit, o valoare numerică unidimensională sau multidimensională (un vector). Această valoare numerică relevă distanţa vectorului de trăsături faţă de graniţele regiunilor sau faţă de "bornele de clasificare".[10]

În lucrarea de faţă evaluarea trăsăturilor s-a realizat cu ajutorul clasificatorului KNN, cu un numărul de vecini k=1,3 sau 5. S-a ales o valoare impară a numărului de vecini doarece s-a dorit evitarea cazurilor în care clasificatorul poate atribuii imaginea de test la două clase diferite în acelaşi timp. d) clasificarea imaginii - este etapa care îmbină rezultatele măsurătorilor multiple anterioare, şi totodată reprezintă etapa finală a sistemului.

Prin clasificare se stabileşte apartenenţa formei, obiectului sau imaginii - descrisă prin vectorul de trăsături, la un set de clase de imagini predefinite.[10]

Clasificarea imaginilor de test, precum şi stabilirea atributelor imaginilor care ne oferă cea mai bună performanţă s-a realizat cu ajutorul algoritmului KNN.

Figura 1.1 Schema procesului de recunoaştere şi clasificare automată a imaginilor[10]

2.2 Transformata Wavelet continuă şi discretă

2.2.1 Transformata Wavelet continuă

Transformata wavelet continuă (CWT- Continuous Wavelet Transform) este folosită la împărţirea funcţiilor de timp continue în unde mai mici.

Ecuaţia transformatei wavelet continuă este următoarea:

XWT(τ,s)=

1

√¿ s∨¿∫ x (t )∗ψ¿ ( t−τs )dt ¿ (1),

unde x(t) este semnalul ce trebuie analizat şi ψ(t) este wavelet-ul mamă sau funcţia de bază [11]. Toate funcţiile folosite în transformare sunt derivate din funcţia de bază prin translatare (shiftare) şi scalare (dilatare sau compresie). Parametrul de translaţie τ se referă la locaţia funcţiei wavelet în timpul parcurgerii semnalului, acesta corespunzând informaţiei de timp a transformatei. Parametrul de scalare s este definit ca |1/frecvenţă| şi corespunde informaţiei de frecvenţă. Scalarea fie dilatează (extinde) sau comprimă semnalul. În prelucrările de imagini, de obicei, se doreşte compresia lor, pentru ca timpul necesar prelucrării să fie cât mai redus. Pe o scară largă de frecvenţe joase semnalul este dilatat, fiind furnizate detaliile ascunse din semnal, în timp ce pe o scară redusă (frecvenţe înalte) semnalul este comprimat, furnizându-se informaţia globală referitoare la semnal. Transformata Wavelet realizează convoluţia semnalului şi prelucrarea acestuia cu funcţia de bază.

3

2.2.2 Transformata Wavelet discretă

Transformata Wavelet discretă (DWT- Discrete Wavelet Transform) este o versiune simplificată a transformării wavelet continuă, bazată pe codarea în sub-bandă. Avantajul acestei transformate constă în simplitatea implementării, reducerea timpului de execuţie şi nivelul mai scăzut de resurse necesare. La transformata CWT, semnalele sunt analizate folosind un set de funcţii de bază care realizează o simplă scalare şi translaţie. În cazul transformatei DWT, o reprezentare în domeniul timp a unui semnal digital este obţinută prin utilizarea tehnicilor de filtrare digitală, semnalul (imaginea) ce trebuie analizat fiind trecut prin filtre cu diferite frecvenţe de tăiere la nivele diferite. Transformata DWT este realizată prin filtrări trece jos şi filtrări trece sus succesive, ale unui semnal discret în domeniul timp (figura 2.1).

Figura 2.1 Arborele cu primele trei nivele de descompunere DWT(arborele Mallat)[11]

În figura de mai sus semnalul este notat cu x[n], unde n este un număr întreg, filtrarea trece jos este realizată de blocul G0, la ieşirea lui obţinând aproximarea grosieră a coeficienţilor (notată a[n]), iar filtrarea trece sus este realizată de H0, la iesire obţinând informaţia detaliată (notată d[n]).

Filtrele care împart banda în jumătate produc semnale ce ocupă doar jumătate din banda de frecvenţă. Filtrarea şi descompunerea vor continua până când se ajunge la nivelul dorit, numărul maxim de nivele de descompunere depinzând de lungimea semnalului (dimensiunea imaginii).

Reconstrucţia semnalului original pe baza coeficienţilor transformatei DWT este procesul invers descompunerii (figura 2.2).

Figura 2.2 Arborele Mallat cu primele trei nivele de reconstrucţie ale semnalului original[11]

4

În Figura 2.2, d[n] reprezintă coeficienţii de detaliu ai semnalului, a[n] aproximările grosiere şi blocurile H1 şi G1 reprezintă filtrele trece sus, respectiv filtrele trece jos de sintetizare a semnalului original.

Procesul de reconstrucţie al semnalului original continuă până când este atins numărul de nivele de descompunere ale semnalului.

Condiţiile ce trebuie îndeplinite pentru a avea o reconstrucţie perfectă sunt:

G0(-z)*G1(z)+H0(-z)*H1(z)=0 | (2)

G0(z)*G1(z)+H0(z)*H1(z)=2z−d (3),

unde G0(z) şi G1(z) sunt filtrele trece jos de analiză, respectiv de sinteză, iar H1(z)şi H0(z) sunt filtre trece sus de analiză, respectiv de sinteză[11].

Prima condiţie impune ca reconstrucţia să se facă fără alias, iar cea de-a doua condiţie impune ca distorsiunile de amplitudine sa aibă valoarea egală cu 1.

2.2.3 Familii de wavelet-uri:

Există un anumit număr de funcţii de bază care pot fi folosite ca funcţii mamă pentru transformata Wavelet, dar pentru utilizarea eficientă a acestora, trebuie luate în considerare detaliile particulare ale aplicaţiei care foloseşte wavelet-uri. Principalele familii de wavelet-uri:

Figura 2.3 Familii de wavelet (a) Haar (b) Daubechies4 (c) Coiflet1 (d) Symlet2 (e) Meyer (f)Morlet (g) Mexican hat [11]

Figura 2.3 ilustrează cele mai utilizate funcţii wavelet. Wavelet-ul Haar este unul din cele mai vechi şi simple wavelet-uri, de aceea orice discuţie despre wavelet-uri începe cu acesta. Pentru mai multe detalii legate de principalele tipuri de wavelet-uri a se consulta [12].

2.2.4 Aplicaţii ale wavelet-urilor

Există o gamă largă de aplicaţii pentru transformata Wavelet care este utilizată în diferite domenii, de la procesarea semnalelor până la domeniul biometriei.

Wavelet-urile au un rol important în compresia datelor, în vederea îmbunatăţirii performanţelor de prelucrare a imaginilor (de compresie a imaginilor). FBI utilizează wavelet-urile ca şi compresie standard a amprentelor, pentru stocarea lor în baza de date. Dintre

5

principalele tipuri de transformate aplicate imaginilor în vederea compresiei lor (ex. transformata cosinus discretă, transformata Fourier discretă 2D etc.), transformata Wavelet asigură asigură o foarte bună rată de compresie.

Transformata Wavelet este aplicată în această lucrare pe imaginile pe nivele de gri, precum şi pe imaginea obţinută în urma aplicării transformatei FFT asupra imaginii pe nivele de gri. Parametrii transformatei, nivelul de descompunere şi familia wavelet, au fost stabiliţi parcurgând următoarele etape:

a) extragerea trăsăturilor imaginilor din baza de date cu metoda I (vezi figura 3.2 pentru mai multe detalii) pentru diferite nivele de descompunere wavelet (36) şi pentru diferite familii de wavelet-uri.

b) clasificarea imaginilor pe baza vectorului de trăsături obţinut prin metoda de mai sus pentru a observa care nivel, respectiv familie wavelet oferă o performanţă de clasificare cât mai bună.

Wavelet-urile sunt folosite atât în metoda I de extragere a trăsăturilor precum şi în metoda II (vezi figura 3.2).

2.3 Transformata FFT

FFT este abrevierea din limba engleză pentru Fast Fourier Transform (Transformata Fourier Rapidă), fiind un algoritm eficient de calcul al transformatei DFT - Discrete Fourier Transform (Transformata Fourier Discretă), precum şi a inversei sale IDFT (Inverse Discret Fourier Transform).

2.3.1 Definirea transformatei FFT

FFT produce exact aceleaşi rezultate ca şi DFT, singura diferenţă fiind reprezentată de rapiditatea transformatei FFT. Fie x0 , x1 , …, x N−1, numere complexe. Transformata DFT este definită de următoarea formulă:

X (k+1 )=∑n=0

N −1

x (n+1)W Nkn , k=0,1,… ,N-1 (4),

iar inversa ei IDFT este:

X (n+1 )= 1N∑k=0

N −1

X (k+1)W N−kn, n=0,1, … ,N-1 (5),

unde j este unitatea imaginară, W N=e− j 2π

n şi N= lungime(x) [13].

Evaluând ecuaţia (4), observăm că aceasta necesită N2 operaţii: sunt N ieşiri X k şi fiecare ieşire necesită o sumă de N termeni. Transformata FFT reprezintă orice metodă de obtinere a aceluiaşi rezultat ca şi DFT în N log N operaţii. Pentru mai multe informaţii legate de transformata FFT şi tipurile de algoritmi FFT a se consulta [13],[14] sau [15].

În lucrarea de faţă transformata FFT este utilizată în cadrul metodei II de extragere a trăsăturilor, fiind aplicată asupra imaginii pe nivele de gri, iar apoi asupra acesteia se va aplica transformata Wavelet (vezi figura 3.2 pentru mai multe detalii).

6

2.3.2 Aplicaţii ale transformatei FFT

Transformata FFT are aplicaţii în următoarele domenii:- compresia datelor (ex. MP3)- analiza spectrală a semnalelor- filtrare- obţinerea răspunsului în frecvenţă a unui sistem- rezolvarea ecuaţiilor parţial diferenţiale- convoluţia în domeniul frecvenţă: - intercorelare - multuplicarea de numere întregi mari - multiplicarea simbolică a polinoamelor

2.4 Transformata Radon

Transformata Radon şi transformata Hough sunt strâns legate una de cealaltă, Radon fiind o formă particulară a transformatei Hough.

2.4.1 Definirea transformatei Radon

O reprezentare utilă a unei drepte este ecuaţia sa în coordonate polare:

xcosθ+ ysinθ=ρ (6),

unde unde ρ reprezintă distanţa dintre dreaptă şi origine, iar θ este unghiul dintre axa x pozitivă şi dreapta ρ [16].

Transformata Radon se defineşte ca integrală de-a lungul unei drepte înclinate cu unghiul θ faţă de axa x pozitivă şi situată la distanţa ρ faţă de origine [17]. Se notează în general cu g(ρ , θ) şi are următoarea formulă:

g(ρ , θ)=∬−∞

+∞

f ( x , y )δ (xcosθ+ ysinθ−ρ)dxdy(7),

unde δ reprezintă funcţia Dirac şi este ilustrată în [16] astfel:

δ (x )={+∞, x=00 , x ≠ 0

(8)

7

Figura 2.4 Reprezentarea grafică a celor două forme ale transformatei Radon- ecuaţia (7) şi (9) [17][18]

Ecuaţia ilustrată în [17]:

g(ρ , θ)=∫−∞

+∞

f (scosθ−u sinθ, ssinθ+u cosθ )du (9),

este echivalentă cu ecuaţia (2), fiind obţinută prin rotirea axelor de coordonate cu unghiul θ ,unde:

s= xcosθ+ y sinθ x=scosθ−u sinθ (10)

u=−x sinθ+ y cosθ y=x sinθ+u cosθ

Transformata Radon reprezintă o imagine ca un set de proiecţii de-a lungul diferitor direcţii, realizând legătura dintre spaţiul de coordonate (x,y) şi spaţiul proiecţiilor (ρ , θ).

Transformata Radon calculează proiecţia intensităţii pixelului pe o linie radială din centrul imaginii la un unghi specificat. Aceasta este utilizată, de obicei, pentru extracţia informaţiei spaţiale unde pixelii sunt corelaţi la un unghi specific.

În metoda de extragere a caracteristicilor din imagini, în lucrarea de faţă trăsăturile Radon sunt calculate pentru unghiurile 00, 450, 900 şi 1350. Apoi, fiecare set de valori rezultat este transformat într-o histogramă cu trei benzi, rezultând astfel un vector cu 4x3=12 valori. Transformata Radon este calculată pentru imaginea pe nivele de gri şi împreună cu "histogramele multi-scală, "primele 4 monemte" şi caracteristicile Tamura formează metoda III de formare a vectorului de trăsături (vezi figura 3.2 pentru mai multe detalii).

2.4.2 Aplicaţii ale transformatei Radon

Transformata Radon are aplicaţii în mai multe domenii cum ar fi:- domeniul medical, în cazul tomografiei compiuterizate- seismologie, în cazul reflexiei seismice- ultramicroscopia ansamblurilor macromoleculare, cum sunt proteinele şi viruşii- în rezolvarea ecuaţiilor hiperbolice parţial diferenţiale- detecţia de formă

2.5 Caracteristicile Tamura

Dintre proprietaţile Tamura folosite în acest proiect se numară:- granularitatea- contrastul- direcţionalitatea.

Aceste trăsături au fost selectate de Tamura, Mori şi Yamawaki pe baza experimentelor psihologice. Pentru mai multe detalii a se consulta [19].

2.5.1 Granularitatea se referă la distanţa dintre variaţiile spaţiale notabile a nivelelor de gri. Procedura compiutaţională propusă, consideră diferenţele dintre valoarea medie a semnalelor corespunzătoare ferestrelor de diferite dimensiuni care nu se suprapun, urmărind paşii de mai jos :

8

1. Pentru fiecare pixel (x,y), calculează şase valori medii pentru ferestrele de dimensiunea 2k × 2k, k=0,1,...,5 în jurul fiecarui pixel.

2. Pentru fiecare pixel, calculează diferenţa absolută Ek(x,y) dintre perechile valorilor medie ce nu se suprapun în direcţiile: orizontală şi verticală.

3. Pentru fiecare pixel, caută valoarea lui k ce maximizează diferenţa Ek(x,y) în orice direcţie şi setează dimensiunea cea mai bună Sbest(x,y)=2k.

4. Calculează trăsătura de granularitate Fcrs prin medierea Sbest(x,y) asupra întregii imagini.

2.5.2 Contrastul relevă modul în care nivelele de gri q, q=0,1,..., qmax, variază într-o imagine g şi a căror distribuţie este direcţionată spre alb şi negru. Pentru definirea contrastului se folosesc momentele centrale de ordinul al doilea şi cele normalizate de ordinul al patrulea, reprezentate de varianţa standard - σ, respectiv indicele de aplatizare - α4:

F con=σ

α 4n

(11 ),

unde: α 4=μ4

σ4 (12 ); σ 2=∑q=0

q max

(q−m )2 Pr ( qg )(13); μ4=∑

q=0

qmax

(q−m)4 Pr (q /g) (14) şi m este

media nivelelor de gri.[19]

2.5.3 Direcţionalitatea

Gradul de direcţionalitate este măsurat folosind distribuţia spectrală a muchiilor locale orientate, faţă de unghiurile direcţionale ale acestora. Soliditatea muchiei e(x,y) şi unghiul direcţional a(x,y) sunt calculate folosind detectorul de muchii Sobel, aproximând "pixel-wise" x şi derivata y a imaginii:

e (x , y )=0.5 (|∆x (x , y )|+|∆y ( x , y )|) (15)

a ( x , y )=tan−1(∆ y ( x , y ) /∆x ( x , y )) (16)

În ecuaţiile de mai sus Δx(x,y) şi Δy(x,y) sunt diferenţele pe verticală şi orizontală a nivelelor de gri dintre pixelii vecini [19]. Diferenţele sunt măsurate utilizând următorii operatori fereastră de dimensiune 3x3 [19]:

−1 0 1 1 1 1 −1 0 1 0 0 0 −1 0 1 −1 −1 −1

Histograma Hdir(a) a valorilor direcţiei cuantizate a este construită prin numărarea pixelilor muchie care un anumit unghi direcţional şi soliditatea muchiei mai mare decât un prag predefinit. Histograma este relativ uniformă pentru imaginile fără o orientare accentuată şi evidenţiază vârfurile pentru imaginile cu un grad al direcţionalităţii ridicat. Gradul direcţionalităţii este legat de ascuţimea vârfurilor şi este descrisă de următoarea ecuaţie:

9

Fdir=1−r npeaks∑p=1

n peaks

∑a∈w p

(a−ap )2 H dir (a) (17),

În ecuaţia (17) npeaks este numărul de vârfuri, ap este poziţia vârfului p, wp este gama de unghiuri atribuite vârfului p, r indică un factor de normalizare legat de nivelele de cuantizare ale unghiului a, şi a este unghiul direcţional cuantizat (în modulo 180o).[19]

Aceste proprietăţi texturale Tamura sunt calculate pe imaginea pe nivele de gri astfel: - 3 valori: contrastul, direcţionalitatea şi granularitatea - o histogramă a granularităţii cu 3 benziAstfel, rezultă astfel un vector de caracteristici cu 6 valori.

Trăsăturile Tamura sunt utilizate în acestă lucrare în cadrul metodelor I, II şi III de extragere a trăsăturilor (vezi Figura 3.2).

2.6 Polinoamele Zernike

Polinomele Zernike au fost dezvoltate la începutul secolului XX de către fizicianul german Frits Zernike (faimos pentru invenţia microscopului fază-contrast, pentru care a câstigat premiul Nobel pentru Fizică în 1953).

Figura 2.5 Valorile Zernike în unitatea de disc [20]

2.6.1 Definirea polinoamelor Zernike

Aceste caracterisitici Zernike sunt un set de polinoame definite pe unitatea de disc (figura 2.5), ce pot fi reprezentate atât în sistemul cartezian (x,y), cât şi în coordonate polare (r,). Cea mai utilizată formă, este descrisă în [21] ca fiind cea polară:

Z j ,impar=√n+1 Rnm (r ) √2cos ( m) , m≠ 0 (18)

10

Z j , par=√n+1 Rnm (r ) √2 sin (m) , m≠ 0 (19)

Z j=√n+1 Rn0 (r ) , m=0 (20),

unde:

Rnm (r )= ∑

s=0

(n−m)/2 (−1 ) s (n−s) !

s !( n+m2

−s)!( n−m2

−s)!rn−2 s

(21)

Valorile lui m şi n sunt întotdeauna întregi şi satisfac condiţile m≤n şi n-m=impar. Indexul j reprezintă modul de ordonare al numerelor, fiind o funcţie j(m,n).

Condiţia de ortogonalitate pentru polinoamele Zernike ilustrată în [21] este:

∫W (r )Z j Zk d2 r=π δ jk(22),

unde:

W (r )={1π

, pentrur ≤ 1

0 , pentru r>1 (23)

2.6.2 Aplicaţii ale polinoamelor Zernike

Baza acestor funcţii este definită pe o suprafaţă circulară, caracteristic planelor pupilelor în procesarea clasică de imagini, pentru lungimi de undă optice şi inflaroşii, printr-un sistem de lentile şi oglinzi cu un diametru finit.

Descompunera polinomială Zernike este utilizată în următoarele domenii:- prelucrare optică, pentru a caracteriza erorile observate în analizele interferometrice, cu scopul de a obţine performanţa dorită.-optometrie şi oftalmologie, la descrierea devierii corneei sau lentilelor pentru o formă sferică ideală, care au ca rezultat erori de refracţie.- optica adaptivă, la înlăturarea distorsiunilor atmosferice. Aplicaţiile în acest domeniu sunt astronomia vizibilă sau inflaroşie (IR) şi redarea imaginilor din satelit. De exemplu, unul dintre factorii Zernike (pentru m=0 şi n=2) este denumit "de-focus". Prin cuplarea iesirii acestui factor la un sistem de control, poate fi implementată o focalizare automată. [21]

Coeficienţii Zernike sunt valori complexe, în descrierea imaginilor folosindu-se valoarea absolută a acestora. Polinoamele Zernike sunt aplicate asupra imaginii pe nivele de gri, constituind metoda IV de extragere a trăsăturilor (pentru mai multe detalii vezi figura 3.2).

2.7 Histograme multi-scală

Pentru acest set de trăsături sunt calculate patru histograme cu un număr variabil de benzi (3, 5, 7 şi 9), după modelul propus în [9]. Fiecare domeniu de frecvenţe corespunde unei histograme diferite, şi astfel numărul variabil de benzi permite măsurarea conţinutului într-un domeniu de valori foarte larg. Maximul histogramelor este folosit pentru normalizarea vectorului de caracteristici rezultat, care are un număr de 1x24 elemente. Histogramele multi-scală sunt aplicate asupra transformatei Wavelet, transformatei FFT şi asupra imaginii originale (imagine

11

pe nivele de gri) contribuind astfel cu un număr total de 3x24 elemente la formarea vectorului de trăsături al imaginilor.

Histogramele multi-scală sunt utilizate în cadrul metodelor I, II şi III de formare a vectorului de trăsături (pentru mai multe detalii vezi figura 3.2).

2.8 Filtre orientate în patru direcţii pentru obţinerea "primelor 4 momente"

Pentru acest set de trăsături imaginea este subdivizată într-un set de "dungi" pentru patru orientări diferite (00, 900, +450 şi −450). "Primele 4 momente" (media, deviaţia standard, skewness şi kurtosis) sunt calculate pentru fiecare "dungă" şi fiecare set de "dungi" este transformat într-o histogramă cu 3 benzi. Având astfel patru momente în patru direcţii transformate în histograme cu trei benzi, rezultă un vector de trăsături care conţine 4x4x3=48 elemente.[9]

"Primele 4 momente" sunt utilizate, la fel ca şi histogramele multi-scală în cadrul metodelor I, II şi III de extragere a trăsăturilor din imaginea originală.

2.9 Algoritmul KNN

KNN este abrevierea din limba engleză pentru K-Nearest Neighbor (cei mai apropiaţi k vecini), fiind un algoritm de învaţare supervizat utilizat în special în problemele de clasificare. Scopul acestui algoritm este acela de a clasifica un nou obiect pe baza atributelor sale în funcţie de setul cunoscut de date de antrenare. Prin această tehnică folosită în special pentru clasificarea datelor în mai multe clase, un nou obiect este clasificat pe baza majorităţii voturilor vecinilor săi, fiindu-i atribuită clasa cea mai frecvent întâlnită printre cei “k” cei mai apropiaţi vecini. Acei “k” cei mai apropiaţi vecini se aleg pe baza distanţei minime dintre obiect şi toate celelalte obiecte din setul de antrenare (setul de date cunoscut).Fiecare obiect este reprezentat în setul de date printr-un vector de trăsături, care în cazul imaginilor poate să conţină caracteristici de formă, de textură sau de culoare.

Există mai multe tipuri de metrici folosite în cadrul algoritmului KNN pentru calculul distanţei minime dintre “noul vector” şi “vectorii” din setul de antrenare:

- distanţa euclidiană- distanţa euclidiană standardizată- distanţa city block (Manhattan)- distanţa cosinus- distanţa coeficientului de corelaţie (distanţa Pearson r)- distanţa hamming- distanţa Maholonobis- distanţa Minkowski- etc

Cea mai frecventă distanţă utilizată în cadrul acestui algoritm este distanţa euclidiană.Fiind dată o matrice X de dimensiune [mxn], care conţine "m" vectori linie (vectorii de trăsături de dimensiune [1xn]) x1,x2,…,xm, unde xk=(x1

k , x2k,…, xn

k), putem defini metricile (distanţele) dintre două obiecte (doi vectori) oarecare xr şi xs (r,s=1m), după cum sunt ilustrate şi în [22], astfel:

- distanţa euclidiană:

12

drs=√ ( xr−x s )(xr−xs)' = √∑

i=1

n

(x ir−x i

s)2 (24)

- distanţa euclidiană standardizată:

dsrs=√ ( xr−x s ) D−1( xr−xs)',

unde D este matricea diagonală, ce are ca elemente dispersia vectorului X i=(x i1 , …, x i

m ), notată d i2,

rezultând:

dsrs=√∑i=1

n

( (xir−x i

s)d i

)2

(25)

- distanţa city block (Manhattan)

dcrs=∑i=1

n

|xir−x i

s| (26)

- distanţa cosinus

dcosrs=(1−xr xs

'

(xr xr' )

12 (xs xs

' )12 ) (27)

- distanţa coeficientului de corelaţie (distanţa Pearson r)

rrs =1−(xr−xr)(xs− xs)

'

√(xr−xr)( xr−xr)'√(xs−xs)(x s−xs)

' , unde xr=∑i=1

n

x ir (28)

- etc, pentru mai multe tipuri de metrici a se consulta [22].

Pentru a întelege şi mai bine funcţionarea algoritmul KNN pe un exemplu numeric a se consulta consulta [24].

2.9.1 Avantajele algoritmului KNN

Unul dintre avantajele sale este uşurinţa implementării, fiind unul dintre algoritmii de clasificare cei mai uşor de înţeles.

O altă calitate a acestei tehnici este eficacitatea sa, în cazul în care, setul de date de antrenare este afectat de zgomot (în special în cazul în care se foloseste ca metrică inversul pătratului distanţei ponderate). Obţinerea distanţei ponderate se face prin ierarhizarea fiecărei trăsături în funcţie de scopul propus. Astfel distanţa euclidiană ponderată va avea urmatoarea expresie:

dw rs= √∑i=1

n

w i(xir−x i

s)2 (29),

13

unde ∑i=1

n

wi=1, iar w i este ponderea atributului (caracteristicii) i [23] .

A nu se confunda ponderarea atributelor cu ponderarea distanţelor. O metodă foarte întâlnită de ierarhizare a distanţelor, este aceea de a-i da fiecarui vecin o

pondere de 1/d , unde d este distanţa pâna la vecin. Astfel vecini mai apropiaţi vor avea o contribuţie mai mare la clasificarea unui obiect. Studiile au aratat că ponderarea distanţelor nu îmbunătăţeşte performanţele algoritmului KNN.

2.9.2 Dezavantajele algoritmului KNN

La aplicarea algoritmului KNN în practică ne lovim de următoarele probleme:a)"Ce metrică utilizăm pentru performanţe cât mai bune?"b)"Care este valoarea optimă pentru k?"c)"Trebuie să folosim toate atributele sau numai anumite atribute ale obiectelor?"

Toate aceste probleme au ca efect creşterea timpului de clasificare.Timpul de clasificare depinde în special de numărul de obiecte din setul de date. Pentru seturile de date cu un număr foarte mare de obiecte, în etapa de preclasificare este necesară o reducere a numărului de atribute pentru fiecare obiect. Acest lucru se realizează prin alegerea unor puncte cheie care să diferenţieze între ele instanţele setului de antrenare cât mai bine.

Numărul optim de vecini se obţine prin testarea algoritmului de mai multe ori, modificând numărul acestora.

Costul de calcul este destul de mare, deoarece trebuie să calculăm distanţa dintre noua instanţă şi fiecare instanţă din setul de antrenare. Acest cost poate fi redus prin utilizarea metodei "K-D tree".[25]

Pentru a vedea eficacitatea metodelor de extragere a caracteristicilor, în această lucrare s-a folosit clasificatorul KNN. A fost ales acest algoritm datorită simplităţii lui, a performanţelor bune de clasificare, atât în ceea ce priveşte acurateţea cât şi timpul de clasificare.

2.10 Fişiere MEX (MEX-files)

MEX este abrevierea din limba engleză pentru MATLAB Executable (Executabile Matlab). Fişierele MEX sunt subrutine dinamice realizate în mediile de programare C, C++ sau Fortran, coduri sursă care compilate pot fi rulate din Matlab în acelaşi mod cum sunt rulate şi fişierele M (M- files) sau orice altă funcţie deja implementată în Matlab. Funcţiile externe de interfaţare realizează transferul de date între MEX- files şi Matlab, oferind totodată şi posibilitatea de a chema funcţii Matlab din programele C, C++ sau Fortran.

Principalele motive de a creea în loc de un M-file un MEX- file sunt următoarele:- abilitatea de a apela o gamă largă de rutine C, C++ sau Fortran deja existente direct din Matlab fără a fi nevoiţi să le rescriem ca un M -file.- viteza de execuţie; putem rescrie programele care folosesc de exemplu bucle FOR ca şi MEX- files pentru eficienţă. Pentru mai multe detalii legate de realizarea MEX- files a se consulta [26].

În această lucrare MEX- files sunt folosite pentru calculul polinoamelor Zernike ale unei imagini, precum şi pentru implementarea clasificatorului KNN. Aceste MEX- files sunt realizate de dezvoltatorii clasificatorului WND-CHARM, respectiv de Roger Jang şi pot fi descărcate gratuit de pe site-urile:http://www.openmicroscopy.org, respectiv http://mirlab.org/jang/matlab/toolbox/dcpr/.

3. Implementarea soluţiei adoptate

14

Scopul lucrării de faţă este acela de a testa diferite caracteristici care să codeze cel mai bine imaginile din baza de date. Pentru a verifica eficienţa metodelor de extragere a trăsăturilor s-a folosit clasificatorul KNN.

În general, un sistem de recunoaştere al obiectelor trebuie să: 1- să extragă atributele care grupeză imaginile într-o anumită clasă şi diferenţiază imaginile din clase diferite2- să clasifice aceste atribute 3- să elimine alarmele false - de aceea avem clasa garbage 4- să identifice clasa imaginii pe baza acestor atribute5- în cazul detecţiei obstacolelor, există posibilitatea apariţiei unui modul de „tracking” sau urmărire care să realizeze urmărirea obiectelor de-a lungul scenei rutiere până în momentul în care se pierd în afara ei şi nu mai reprezintă nici un pericol.

În această lucrare s-a presupus că obiectele sunt deja segmentate (detectate), baza de date fiind formată din imagini care încadrează doar obiectele şi nu din scene întregi care să includă mai multe obiecte. Astfel, în această lucrare este tratat numai pasul de extragere al trăsăturilor pentru modulul de clasificare.

La început s-a încercat extragerea caracteristicilor din imagini doar pe baza transformatei Wavelet, ceea ce implică redimensionarea imaginilor la aceeaşi scală pentru a obţine acelaşi număr de coeficienţi. Imaginile din baza de date au diferite dimensiuni (unele ilustrează obiecte mai apropiate având implicit dimensiuni mai mari- maxim 434x768 pixeli, altele obiecte mai depărtate, având dimensiuni mai mici- minim 89x69 pixeli), iar pentru clasificare este necesar obţinerea unui număr fix de caracteristici pentru fiecare imagine. Folosirea caracteristicilor wavelet în multiple surse bibliografice ne-au făcut să concluzionăm că performanţele scăzute obţinute se datorează redimensionării imaginilor şi nu transformatei Wavelet. Din acest motiv s-a renunţat la redimensionare şi s-a încercat găsirea unor metode de extragere a trăsăturilor care prin aplicarea lor asupra imaginilor să returneze un număr fix de coeficienţi indiferent de dimensiunea imaginii.

Sistemele de clasificare folosesc la intrare vectori de caracteristici care definesc obiectele din imagini. Aceste caracteristici reprezintă şablonul (pattern-ul) obiectului, iar sabloanele obiectelor care aparţin mai multor clase vor fi esenţiale pentru procesul de învăţare şi testare al sistemului. Pentru obţinerea caracteristicilor s-au folosit o serie de transformate, combinaţii de transformate şi de metode de extragere printre care se pot enumera:- transformata Wavelet- transformata FFT- transformata Radon- caracteristicile Tamura- histogramele multi-scală- filtre orientate în patru direcţii pentru obţinerea "primelor 4 momente"- polinoamele Zernike.

În pasul de clasificare, algoritmul de evaluare se bazează pe calculul de distanţe între vectorii de caracteristici corespunzători obiectelor. Pentru a detecta şi a recunoaşte caracteristicile altor obiecte noi, sistemul trebuie învăţat apriori cu aceste şabloane prin intermediul caracteristicilor extrase. Sistemul odată învăţat, poate fi folosit doar pentru testare, iar dacă se doreşte adăugarea de noi instanţe în setul de antrenare, se va mai trece încă o dată prin etapa de învăţare. Metodele de extragere enumerate mai sus au fost studiate pentru evaluarea performanţelor ce se pot obţine cu ajutorul lor, sau chiar prin diferite combinaţii ale lor. Caracteristicile extrase au fost utilizate de clasificator (KNN) pentru a se realiza recunoaşterea automată a obiectelor.

3.1 Baza de imagini

15

Baza de date este formată din imaginile unor obstacole ce pot fi întâlnite de conducătorul unei maşini pe durata deplasării. Există posibilitatea ca obstacolele întâlnite să nu fie observate la timp sau să distragă atenţia conducătorului. Din acest motiv au fost dezvoltate sisteme de detecţie şi recunoaştere a obstacolelor care să atenţioneze conducătorul asupra pericolelor reprezentate de acestea.

În mediul urban obstacolele ce pot fi întâlnite sunt reprezentate de alte maşini sau de pietoni. Faţă de mediul urban, în mediul rural se pot întâlni şi alte obstacole cum sunt animalele. De aceea baza de imagini va fi formată din clasele maşini, pietoni şi animale.

Baza de imagini este construită din 800 de imagini color, împărţite în patru clase după cum urmează:- 200 de imagini cu maşini- 200 de imagini cu pietoni- 200 de imagini cu animale (câini, pisici, vaci, oi, cai)- 200 de imagini alcătuind clasa garbage.

După cum se poate observa în figura 3.1 imaginile au fost selectate manual şi au fost extrase doar obiectele de interes din acestea. Apoi imaginile au fost transformate în imagini pe nivele de gri.

Un sistem unitar presupune existenţa detecţiei şi recunoaşterii (clasificării) robuste. Detecţia şi clasificarea bazată doar pe imaginile din domeniul vizibil în general nu oferă performanţe prea bune în orice condiţii, de aceea sistemele actuale folosesc şi alţi senzori pentru realizarea detecţiei şi recunoaşterii obstacolelor. Cum în lucrarea de faţă recunoaştere automată a obstacolelor se realizează numai pe baza imaginilor din domeniul vizibil ne aşteptăm ca sitemul de clasificare să dea rateuri. De aceea a fost introdusă şi clasa de imagini garbage.

După cum se poate observa în figura 3.1, imaginile care alcătuiesc clasa garbage au fost obţinute din fundalul imaginilor celorlalte clase. Această clasă este utilă la detectarea alarmelor false.

În figura de mai jos sunt ilustrate diferite imagini din fiecare clasă:

Maşini:

Pietoni:

Animale:

16

Garbage:

Figura 3.1 Imagini din baza de date

După ce caracteristicile au fost extrase, ele au fost introduse în clasificator pentru a

realiza clasificarea imaginilor în cele patru clasele. În general pentru crearea unei baze de imagini care să fie cât mai bună (din punct de

vedere al rezultatelor de clasificare), sunt respectate următoarele principii:- toate imaginile să fie realizate cu aceleaşi procedee (cu acelaşi aparat de fotografiat sau cameră de filmat)- parametrii mijloacelor de captare să fie identici pentru toate imaginile (rezoluţie, contrast, dimensiune, etc)- să aibe un număr de imagini care să permită obţinerea unor rezultate de clasificare satisfăcătoare.

Deoarece nu a mai fost creată o bază de imagini ca şi cea utilizată în lucrarea de faţă şi realizarea unei astfel de baze de imagini necesită foarte mult timp, au fost folosite imagini care fac obiectul altor baze de date disponibile gratuit pe site-ul: http://pascallin.ecs.soton.ac.uk/challenges/VOC/databases.html.

Bine înţeles că baza de imagini formată, nu este la fel de bună ca cea care respectă principiile enumerate mai sus, deoarece procedeul de înregistrare, rezoluţia, contrastul şi dimensiunile imaginilor diferă de la o bază de imagini la alta.

3.2 Metoda de extragere a caracteristicilor

După crearea bazei de imagini, s-a realizat extragerea caracteristicilor din imagini prin intermediul diferitor transformate de imagini (transformata Wavelet, transformata FFT, trans-formata Radon) şi altor moduri de extragere ("primele 4 momente", histograme multiscalare, caracteristicile Tamura - granularitatea, contrastul şi direcţionalitatea, şi polinoamele Zernike).

După cum se poate observa în figura 3.2, aceste transformate şi celelalte procedee de extragere a caracteristicilor enumerate anterior, sunt distribuite în patru metode de extragere a caracteristicilor, astfel:

Metoda I

Metoda II

17

Metoda III

Metoda IV

Figura 3.2 Schema bloc a metodelor de extragere a trăsăturilor

Metodele de extragere a trăsăturilor, după cum se poate vedea în figura 3.2, au fost denumite metoda I, metoda II, metoda III şi metoda IV pentru ca referirea la acestea să se realizeze mult mai uşor.

Privind figura 3.2 se poate observa că metoda I şi metoda II diferă ca şi structură numai prin prizma imaginilor pe care sunt aplicate (metoda I se aplică pe imaginea obţinută în urma transformatei Wavelet a imaginii pe nivele de gri, iar metoda II pe cea obţinută în urma transformatei Wavelet a transformatei FFT). Numărul de trăsături obţinute prin aplicarea acestor două metode este acelaşi indiferent de imaginea pe care sunt aplicate (imagine pe nivele de gri, cea rezultată în urma transformatei Wavelet sau cea rezultată în urma transformatei Wavelet a transformatei FFT) şi indiferent de dimensiunea acesteia, doarece cele trei blocuri "primele 4 momente", histograme multi-scală şi caracteristicile Tamura contribuie cu un număr constant de trăsături la formarea vectorului de caracteristici (48, 24, respectiv 6).

Astfel, asupra transformatei Wavelet a imaginii, cât şi asupra transformatei Wavelet a trasnformatei FFT, se vor aplica următoarele funcţii de compresie a numărului de coefienţi:a) Histogramele multi-scală - funcţie care transformă imaginea de intrare în patru tipuri de histograme, cu 3, 5, 7 şi 9 benzi, rezultând astfel 24 de valori. Aceste valori sunt normalizate cu maximul lor.b) "Primele 4 momente" - funcţie care returnează un număr de 48 de coeficienţi, prin parcurgerea imaginii:- pe diagonală (atât din strânga jos pâna în dreapta sus, cât şi din dreapta jos până în stânga sus) cu un pas care depinde de valoarea rotujită a împărţirii dimensiunii pe vericală a imaginii la zece (round(dim_verticală/10)). La fiecare pas se calculează valoarea mediei, deviaţiei standard, skewness şi kurtosis a pixelilor parcuşi. Coloanele matricei astfel obţinută (care are stocate pe fiecare linie cele patru valori menţionate) sunt transformate în histograme cu 3 benzi, rezultând un număr de 4x3=12 trăsături pentru fiecare imagine.- pe orizontală şi pe verticală, cu deosebirea că faţă de parcurgerea pe diagonală cea realizată pe verticală se va face cu un pas care depinde de dimensiunea orizontală a imaginii, iar cea

18

verticală se va face cu un pas care depinde de dimensiunea orizontală a imaginii. În rest se procedează la fel ca şi la parcurgerea pe diagonală.

Aşadar, pentru cele patru parcurgeri (două pe diagonală, una pe verticală şi una pe orizontală) se obţin un număr de [4 parcurgeri]x[4 coloane]x[3 benzi ale histogramelor]=48 trăsături pentru orice imagine asupra căreia s-a aplicat această metodă de reducere a caracteristicilor.c) Trăsăturile Tamura se compun din directionalitatea imaginii, contrastul, granularitatea şi o histogramă a granulitaţii cu 3 benzi, rezultând 6 caracteristici pentru fiecare imagine.

Până acum au fost trecute în revistă primele două metode de reducere a atributelor unei imagini (metoda I şi metoda II), iar în continuare vor fi abordate celelate două metode - metoda III şi metoda IV.

În cadrul metodei III de reducere a atributelor, blocurile: "primele 4 momente", histograme multi-scală, caracteristicile Tamura, au aceeaşi funcţionare ca şi în cazul blocurilor similare din metoda I şi metoda II, cu deosebirea că acestea acţionează asupra imaginii originale (imagine pe nivele de gri). Acestor blocuri i se adaugă şi transformata Radon.

Pentru a realiza transformata Radon s-a utilizat funcţia deja implementată în Matlab:R = radon(I, theta) care returnează transformata Radon R a intensitaţii imaginii I pentru un unghi de theta grade [23].

Au fost calculate transformatele Radon pentru patru valori ale lui theta - 00, 450, 900 şi 1350. Fiecare coloană a lui R va conţine transformata Radon pentru fiecare unghi din theta. Apoi coloanele matricei R sunt transformate în patru histograme a câte trei benzi fiecare. Astfel, transformata Radon participă cu un număr total de 4x3=12 trăsături la formarea vectorului de caracteristici.

Metoda IV de extragere a trăsăturilor constă în descompunerea polinomială Zernike a imaginilor pe nivele de gri. Rezultatele obţinute în urma aplicării polinoamelor Zernike asupra imaginii sunt valori complexe, şi de aceea descriptorii imaginii vor fi modulul acestor valori (valoarea absolută).

La aceste metode s-a ajuns pornind de la cele descrise în [9] pentru formarea vectorului de trăsături din cadrul clasificatorului WND-CHARM.

3.2.1 Metoda de extragere a caracteristicilor din WND-CHARM

Metoda propusă pentru formarea vectorului de trăsături al clasificatorului WND-CHARM este ilustrată în următoarea figură:

19

Figura 3.3 Schema de formare a vectorului de trăsături din cadrul WND-CHARM [9]

După cum se poate observa în figura 3.3 pentru formarea vectorului de trăsături s-au utilizat diferite transformate ale imaginilor (transformata Wavelet, transformata Chebyshev şi transformata FFT), precum şi combinaţii ale acestor transformate (transformata Wavelet a transformatei FFT şi transformata Chebyshev a transformatei FFT). Apoi din rezultatele obţinute în urma acestor transformate, au fost extrase diferite trăsături, care sunt grupate în funcţie de tipul lor (caracteristici de mare contrast, de descompunere polinomială, de statistică şi textură) în patru grupe astfel:

Figura 3.4 Grupele de caracteristici din WND-CHARM [9]

În figura 3.4 este descrisă componenţa fiecărei grupe de caracteristici. Astfel, grupa A cuprinde următoarele caracteristici de contrast înalt (de formă): - statisticile muchilor care sunt calculate pe gradientul imaginii originale.Prin extragerea acestor statistici se obţin 28 de trăsături.- coeficienţii Gabor se obţin prin utilizarea wavelet-urilor Gabor [9], obţinându-se un număr de 7 coeficienţi pentru fiecare imagine.- statisticile obiectelor sunt calculate pe imaginea binarizată prin intermediul pragului Otsu [9]. În total statisticile obiectelor cuprind 34 de caracteristici.

După cum se poate observa în figura 3.3 caracteristicile din grupa A sunt extrase numai din imaginea originală, contribuind astfel cu un număr de 28+7+34=69 caracteristici la formarea vectorului de trăsături.

Grupa B reprezentată de caracteristicile de descompunere polinomială (de geometrie), are în componenţă următoarele trăsături:- statisticile Chebyshev- Fourier sunt extrase prin aplicarea asupra imaginii a transformatei Chebyshev- Fourier. Vectorul obţinut prin intermediul acestei transformate va fi transformat într-o histogramă cu 32 de benzi. Astfel se vor obţine un număr de 32 de caracteristici Chebyshev- Fourier.- statisticile Chebyshev sunt obţinute prin transformarea coeficienţilor rezultaţi în urma transformării Chebyshev a imaginii într-o histogramă cu 32 de benzi.- polinoamele Zernike - prin descompunerea polinomială Zernike se obţin 72 de coeficienţi complecşi, dar ca descriptori ai imaginii se folosesc valorile absolute ale acestora.

După cum se poate observa în figura 3.3 caracteristicile din grupa B sunt extrase din imaginea originală şi imaginea rezultată în urma transformatei FFT a imaginii originale, contribuind astfel cu un număr de 2x(32+32+72)=272 caracteristici la formarea vectorului de trăsături.

Grupa C, după cum se poate observa în figura 3.4 este compusă din următoarele caracteristici de statistică a pixelilor şi de textură: - primele 4 momente sunt reprezentate de media, deviaţia standard, skewness şi kurtosis imaginii.

20

Fiecare din cele patru caracteristici enumerate este formată dintr-o histogramă cu 12 benzi, rezultând 48 de trăsături pentru fiecare imagine. - trăsăturile Haralick sunt calculate cu ajutorul matricelor concurente ale imaginilor. Aceste trăsături cuprind un număr de 28 valori. - histograme multi-scală sunt obţinute prin transformarea imaginii în patru tipuri de histograme, cu 3, 5, 7 şi 9 benzi, rezultând astfel 24 de valori. - caracteristicile Tamura se compun din direcţionalitatea imaginii, contrastul, granularitatea şi o histogramă a granularităţii cu 3 benzi. Aceste trăsături contribuie cu un număr de 6 caracteristici la formarea vectorului de trăsături.

După cum se poate observa în figura 3.3 caracteristicile din grupa C sunt extrase din transformata Wavelet a imaginii originale şi transformata Wavelet a transformatei FFT a imaginii originale, contribuind astfel cu un număr de 2x(48+28+24+6)=212 caracteristici la formarea vectorului de trăsături.

Grupa D este formată din statisticile pixelilor şi caracteristicile de textură ce fac parte din grupa C la care se adaugă şi caracteristicile Radon a imaginii originale. Prin aplicarea transformatei Radon asupra unei imagini se obţine un număr total de 4x3=12 trăsături.

După cum se poate observa în figura 3.3 caracteristicile din grupa D sunt extrase din imaginea originală, transformata FFT a imaginii originale, transformata Chebyshev (a imaginii originale şi a transformatei FFT a imaginii originale), contribuind astfel cu un număr de 4x(48+28+24 +6+12)=472 caracteristici la formarea vectorului de trăsături.

Pentru mai multe detalii despre modul în care au fost calculate caracteristicile din grupele A, B, C şi D a se consulta [9].

3.2.2 Metoda de extragere a caracteristicilor adoptată

În această lucrare formarea vectorului de caracteristici s-a realizat având ca referinţă figura 3.3. Pentru obţinerea unor timpi de extragere a trăsăturilor şi de clasificare mai buni este necesar a se utiliza un vector de trăsături cu o dimensiune cât mai mică. Astfel, pentru calculul vectorului de caracteristici, în lucrarea de faţă se vor utiliza un număr mai redus de trăsături.

Pentru reducerea numărului de trăsături, dar şi din cauza numărului foarte mare de posibilităţi de formare a vectorului de trăsături (disponibile în figura 3.3), în această lucrare s-a procedat astfel: - s-a plecat de la formarea vectorului de trăsături prin împărţirea figurii 3.3 în mai nouă metode de extragere caracteristicilor (primele nouă linii ale tabelului 3.1) şi testarea fiecărei metode în parte.

- s-au realizat combinaţii ale celor nouă metode de extragere (după cum se poate observa în tabelul 3.1) până când s-a ajuns la o performanţă de clasificare satisfăcătoare.

- încă de la început s-a renunţat din grupa A la coeficienţii Gabor (datorită numărului mic de trăsături şi timpului de obţinere mai ridicat comparativ cu celelalte caracteristici ale grupei), din grupa B la statisticile Chebyshev-Fourier (deoarece utilizează pentru calcul o mare parte din memorie şi timpul de obţinere este foarte mare), din grupa C la trăsăturile Haralick (datorită timpului de obţinere foarte mare şi modului complicat de calcul).

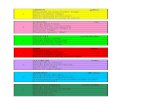

Nr.crt. Metoda de extragere a trăsăturilor

Acurateţe KNN Weka [%]

Acurateţe KNN Matlab

[%]k k

1 3 5 1 3 51. imagine → transformata Wavelet → grupa C 70.6 68 70 70 62 68.32. imagine → transformata Chebyshev → grupa D 66.1 66.5 62.7 65.7 64.4 63.73. imagine → transformata FFT → transformata 68 67.5 75.5 66.3 65.6 74

21

Wavelt → grupa C4. imagine → transformata FFT → transformata

Chebyshev → grupa D64.8 65.4 65.3 63.2 61.3 63.2

5. imagine → transformata FFT → grupa B 68.9 67.2 65.8 68 67.3 65.86. imagine → transformata FFT → grupa D 59 53.3 60 56.9 51.9 58.57. imagine → grupa A 62.7 62.7 60.4 63 64.3 61.38. imagine → grupa B 81.5 80.7 83.5 80.6 81.9 82.89. imagine → grupa D 82.5 83.5 82.5 85 86.2 87

10.imagine → transformata Wavelet → grupa C +imagine → grupa A 70 71 73 69.3 70.6 70

11.imagine → transformata Wavelet → grupa C +imagine → grupa A + imagine → transformata FFT → transformata Wavelet→ grupa C

70.6 73.7 72 69.3 71.2 70

12.imagine → transformata Wavelet → grupa C +imagine → grupa A + imagine → grupa B 70 71 73 69.3 70.6 70

13.imagine → transformata Wavelet → grupa C+ imagine → transformata FFT → grupa B 81 80.5 79.8 81.8 81.2 80.6

14.imagine → transformata Wavelet → grupa C +statisticile Radon extrase din imaginea originală

86.8 86.8 86.2 86.2 87.5 87.5

15.imagine → transformata Wavelet → grupa C + statisticile Chebyshev extrase din imaginea originală

73.7 71.2 73 70.6 70.6 70.6

16.

imagine → transformata Wavelet → grupa C + statisticile Chebyshev extrase din imaginea originală + statisticile Radon extrase din imaginea originală

82.5 85 85 82.5 82.5 80

Nr.crt. Metoda de extragere a trăsăturilor

Acurateţe KNN Weka [%]

Acurateţe KNN Matlab

[%]k k

1 3 5 1 3 517. imagine → transformata Wavelet → grupa C +

imagine → grupa D85.6 85 82.5 87 88.7 88

18.imagine → transformata Wavelet → grupa C +imagine → grupa D + imagine → grupa B 87.5 87.8 85 90 86.9 87.5

19.imagine → transformata Wavelet → grupa C +imagine → grupa D+ imagine → grupa B+ imagine → transformata FFT → transformata Wavelet → grupa C

87.9 87.5 85.6 91.3 86.3 86.3

Tabel 3.1 Metode de extragere a trăsăturilor analizate

În tabelul 3.1 sunt ilustrate valorile acurateţii de clasificare (pentru metodele specificate de extreagere a trăsăturilor) obţinute atât în Matlab cât şi în Weka, prin intermediul clasificatorului KNN, respectiv IBk pentru un număr de vecini k= 1, 3 sau 5.

După cum se poate observa în tabelul 3.1, metoda de extracţie a trăsăturilor care oferă cea mai mare acurateţe este descrisă în ultima secţiune a acestuia.

22

Nu s-a mai continuat testarea altor combinaţii de metode de extragere a trăsăturilor deoarece s-a obţinut o acurateţe de clasificare satisfăcătoare şi pentru ca timpul de extragere a trăsăturilor pentru toate imaginile din baza de date să nu mai crească (pentru că este şi aşa unul foarte ridicat- 3 ore şi 12 minute).

Asfel, s-a ajuns la următoarea schemă de formare a vectorului de caracteristici, care este utilizat mai departe în această lucrare:

Figura 3.5 Schema de formare a vectorului de trăsături

Figura 3.5 reprezintă schema de formare a vectorului de caracteristici pentru care s-a obţinut o acurateţe de clasificare satisfăcătoare prin intermediul clasificatorului IBk din Weka şi clasificatorului KNN implemantat în Matlab.

Metodele de extragere a trăsăturilor ilustrate în figura 3.5 sunt descrise mai amănunţit în în figura 3.2 şi în secţiunea 3.2 a lucrării de faţă.

După cum se observă în figura 3.5 vectorul de caracteristici al fiecărei imagini va fi format din 318 trăsături. Pentru întreaga bază de imagini vectorul de trăsături va fi format din 800 de imagini x 318 trăsături.

3.2.3 Evaluarea trăsăturilor în Weka

Weka este un sistem foarte puternic cu ajutorul căruia se poate realiza numai clasificarea obiectelor (nu şi extragerea caracteristicilor).Utilitarul poate fi descărcat gratuit de pe site-ul: http://www.cs.waikato.ac.nz/ml/weka/. Acesta a fost utilizat pentru a aplica o metodă de învăţare aupra vectorului de caracteristici şi pentru a analiza rezultatele obţinute. Înainte de aplicarea oricărui algoritm de clasificare asupra datelor, acestea trebuie convertite în fisiere ARFF ("Attribute-Relation File Format").

Structura fişierului ARFF trebuie să respecte următoarea formă:

23

Figura 3.6 Structura fişierului ARFF la modul general

Figura 3.6 ilustreză modul de formare al unui fişier ARFF, în vederea antrenării şi testării unui clasificator ales din Weka cu trăsăturile extrase din imaginile cuprinse în baza de date.

Astfel, pentru vectorul de caracteristici format pe baza schemei din figura 3.5, structura fişierului ARFF va fi următoarea:

Figura 3.7 Structura fisierului ARFF utilizat în acestă lucrareÎn figura 3.7 este prezentată schema de formare a fişierului ARFF adaptată la această

lucrare. Aşadar, fiecare atribut trebuie descris în header-ul fişierului ARFF, fişierul conţinind

informaţii atât despre tipul fiecărui atribut, precum şi despre clasa din care face parte respectivul obiect.

Clasa fiecărui obiect trebuie să fie cunoscută, pentru ca la testare să se poată compara clasa prezisă de clasificator cu clasa reală a obiectului respectiv. Dupa antrenarea (învăţarea) datelor se obţine o matrice de confuzie ("confusion matrix") având dimensiunea [număr_clase x număr_clase], în cazul nostru 4x4, care arată numărul instanţelor atribuite fiecărei clase de obiecte. Dacă toate instanţele au fost clasificate corect atunci doar elementele diagonalei principale ale matricei de confuzie sunt diferite de zero. Un exemplu de matrice de confuzie obţinute în Weka este ilustrat în figura 3.8.

==Matricea de confuzie==

M P A G160 0 0 0 |M=1

0160 0 0 | P=2

==Matricea de confuzie==

M P A G40 0 0 0 |M=10 36 3 1 | P=21 2 34 3 |A=3

24

0 0 160 0 |A=3

0 0 0160 |G=4

(a)

3 0 9 28 |G=4

(b)

Figura 3.8 Matricele de confuzie pentru învăţare, respectiv testare

Notaţiile realizate în figura 3.8 au următoarele seminificaţii: M - clasa maşini, P - clasa pietoni, A - clasa animale şi G -clasa garbage.

În figura 3.8 se poate observa că la învăţare toate obiectele au fost atribuite corect claselor din care fac parte (figura 3.8 a). În etapa de testare (figura 3.8 b):- toate obiectele din clasa maşini (prima linie a matricei din figura 3.8 b) au fost clasificate corect